Coches sin conductor: Quién debería morir en un accidente?

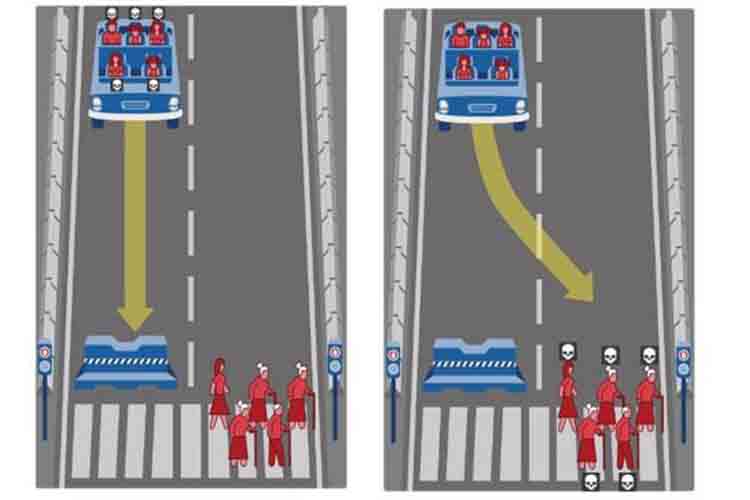

Si se ve obligado a elegir, Quién debería morir en un accidente?. A quién debe matar un coche autónomo en un accidente inevitable?

¿Deberían sacrificarse los pasajeros del vehículo para salvar a los peatones? ¿O debería matarse a un peatón para salvar a una familia de cuatro en el vehículo?

Para acercarse a una respuesta, si es que es posible, los investigadores del MIT Media Lab han analizado más de 40 millones de respuestas en un experimento.

Su Máquina Moral ha revelado cómo las actitudes difieren en todo el mundo.

¿Cómo funcionó el experimento?

Pensar a quién debe matar un automóvil que conduce por sí mismo es un giro moderno a un viejo dilema ético conocido como el problema del trolley.

La idea fue explorada en un episodio de la serie de NBC The Good Place, en el que el profesor de ética Chidi conduce un tranvía fuera de control.

Si no realiza ninguna acción, el tranvía se llevará por delante a cinco ingenieros que trabajan en las vías.

Si desvía el tranvía hacia una vía diferente, salvará a los cinco ingenieros, pero el tranvía llegará a otro ingeniero que de otro modo habría sobrevivido.

La Máquina Moral presentó varias variaciones de este dilema que involucra a un coche autónomo.

Las personas se presentaron con varios escenarios. En caso de que un coche sacrifique a sus pasajeros o se desvíe para golpear:

- una exitosa persona de negocios?

- un criminal conocido?

- un grupo de personas mayores?

- una manada de vacas?

- peatones que estaban cruzando la calle cuando se les dijo que esperaran?

Después de lanzar el experimento, los investigadores publicaron un análisis de los datos en la revista Nature.

¿Qué encontraron?

Los resultados de 40 millones de decisiones sugirieron que las personas preferían salvar a los humanos en lugar de a los animales, salvar la mayor cantidad de vidas posible, y tendían a salvar a los jóvenes antes que a los ancianos.

También hubo tendencias más pequeñas de salvar a las mujeres en lugar de a los hombres, salvando a aquellas de mayor estatus sobre las personas más pobres, y salvando a los peatones en lugar de a los pasajeros.

Cerca de 490.000 personas también completaron una encuesta demográfica que incluía su edad, género y opiniones religiosas. Los investigadores dijeron que estas cualidades no tuvieron un «impacto considerable» en las decisiones que tomaron las personas.

Los investigadores encontraron algunas diferencias culturales en las decisiones que tomaron las personas. Las personas en Francia tenían más probabilidades de aumentar el número de personas que serían asesinadas, mientras que las de Japón pusieron el menor énfasis en esto.

Los investigadores reconocen que su juego en línea no era un estudio controlado y que «no podía hacer justicia a toda la complejidad de los dilemas de los vehículos autónomos».

Sin embargo, esperan que la Máquina Moral genere una «conversación global» sobre las decisiones morales que tendrán que tomar los vehículos automáticos.

«Nunca en la historia de la humanidad hemos permitido que una máquina decida de forma autónoma quién debería vivir y quién debería morir, en una fracción de segundo, sin supervisión en tiempo real. Vamos a cruzar ese puente en cualquier momento», dijo el equipo.

Quién debería morir en un accidente?